Hvor ofte har vi ikke hørt at om man ikke kan bestå en blindtest så er det ingen forskjell? AB blindtester har lenge vært dimensjonerende for industrien og vår forståelse av behovet for teknologien inn vår hobby. Når det da kommer noen å forteller at: hør nå her, er dere sikker. Forskningen sier noe annet. Så er det ikke rart at det reageres.

Kunchur redegjør for forskningen på hvordan vår hørsel fungerer. Han viser hvor utrolig komplekst dette systemet er, og hvor mange ulike mekanismer som virker inn på ulike oppgaver. Han viser oss (og forklarer detaljert) blokkdiagram over vår viktigste ”komponent”, hørselen.

Basert på forskningen kan han derfor redegjøre for hvorfor korte AB tester har sin klare begrensning. Hvorfor det er viktig med slow listening…..at sånn er vår hørsel bygget opp at siden den et ett mye kraftigere verktøy enn man visste.

This article surveys and provides new insights into some of the impressive capabilities of the human auditory system and explores their relationship to fidelity in reproduced sound.

Basert på denne innsikten som alle lesere burde sette seg litt inn i kan man konkludere annerledes enn om man la Fourier, lineære systemer, og AB tester til grunn. Linker derfor til to lettleste artikler fra Audio Praxis som alle burde kunne lese noen ganger til de sitter. Basis informasjon om hvordan vår hørsel fungerer og sammenhenger mellom frekvens, fase og tid.

Noen godbiter på slutten:

- The ear’s cochlear output is represented by the neural excitation pattern of 30000 nerve fibers, originating from 3500 IHC channels, that differentiate frequency, level, phase and onset times. This NEP hosts an astronomical number of variations and resolution of detail of RD > 1032 even for elderly listeners whose fmax is only 4 kHz.

- The cochlear output is influenced by the ear’s non-linearity, various active-control mechanisms, and descending neural feedback from higher centers. For loud sounds, the acoustic reflex acts within ~10 ms to protectively tighten the ear drum and pull away the stapes. As IHC channels are steadily stimulated the cochlear amplifier enhances the frequency tuning, sensitivity, and dynamic range of the channels, in 3 stages occurring on ~15 µs, ~240 µs, and >1 ms time frames.

- It can be roughly estimated that a HEA component may need τ ~ 1–10 µs and τc ~ 10–100 µs to be sufficiently transparent—conditions that may be satisfied by some cables and (pre) amplifiers, but probably not by most source components nor speakers.

- A lot of the controversy surrounding high-end and high-resolution audio arises because most of the community is unaware of many basic and essential facts about human hearing.

Linker til Basis Informasjon

Dette er interessant, ikke fordi det sier noe av betydning om AB-testing, men fordi det er en ganske hårreisende måte å behandle påstander, data og sitater på. Artikler i AudioXpress har en tendens til å bli tatt seriøst selv om det til en stor del regnes som et hobbymagasin. De har heller ikke en faglig kompetent redaksjon så dette er på ingen måte en fagfellevurdert artikkel, bare så det er krystallklart. Siden kort vs lang AB-testing er det interessante her kan vi fokusere på det som handler om nettopp dette.

La oss begynne med påstandene:

Kunchur hevder vel ikke direkte at det er noen nye oppdagelser i dette, men påpeker at hørselen er mer kompleks enn mange tror. Der er jeg helt enig, men det ser ut til at dette ofte blir lest som "hørselen har langt mindre begrensninger enn vitenskapen har trodd". Jeg ville bare få dette av veien først, dette er altså ikke ny kunnskap på noen som helst måte, og det er heller ikke mitt inntrykk at Kunchur hevder dette, men det ser ut til å bli tolket slik av de som ønsker å ekstrapolere fra sitatet fra artikkel to.

For i artikkel to skriver han følgende påstand:

Resolution of Detail

The 3500 “analog” (continuously variable) IHC voltages are represented by the “digitized” firing pattern of 30,000 auditory nerve fibers (referred to collectively as the neural excitation pattern or NEP). The instantaneous information this represents is so enormous that to describe it as “astronomical” is an insult to the ear. A very conservative lower bound [1] for the resolution of detail (number of variations) is RD >10e40—a number that has 17 more zeros than all the stars in the universe! [2] This information undergoes massive neural processing as indicated in Figure 3. This flow chart is shown here to inspire an appreciation for the incredible sophistication of human auditory neurophysiology; its detailed workings are explained elsewhere [1].

Det spesielle her er at han antyder en sensasjonelt stor mengde data for å si det forsiktig. Han støtter seg på en referanse, som ikke overraskende er en artikkel han selv har skrevet. Avsnittet der han behandler nettopp dette lyder som følger:

In addition to DR and sensitivity, the vast information contained in the NEP represents an astronomical resolution of detail (RD). At a crowded party, we can focus on a single voice being drowned by hundreds of competing sounds, and still notice our name being called amidst the racket—the so-called “cocktail-party effect” [89] [90] [91]. In music, we are aware of the faint reverberation of past notes superposed on the million times more intense currently playing notes; in fact, their ratio serves as a depth perception cue (see below). All this is possible because of a huge RD, which we now estimate from the known DR and JNDs. Pure-tone JNDs arise collectively from a group of adjacent hair-cell rows, not just one. As a conservative estimate, we will take an entire ERB (~90 channels) as such a group with its DR ~100 dB subdivided by ~100 levels spaced by JNDs of ~1 dB. The frequency range is thus divided into 40 such groups. The NEP can then be thought of as a 40-digit base-100 number that can have 10040 = 1080 distinct values. Even pessimistically estimating each ERB to have only ~10 distinct levels27 yields RD >1040 as a very conservative lower bound. The footnotes28 show some alternative calculational approaches for estimating RD, which reinforce the above RD >1040 lower bound. Even elderly audiophiles who have lost a couple of octaves (i.e., 8 ERBs) of high-frequency hearing (i.e., fmax = 4.5 kHz instead of 18 kHz) will have an RD > 1032 that is beyond astronomical29!

Det kan se ut til at han legger til grunn antallet nervetråder, multipliserer dette med antall decibel vi kan høre fra svakest til sterkest, og multipliserer dette med tidsoppløsningen gitt av evnen til å skille transienter i tid og generere vinkelinformasjon. Han behandler så dette som et komplett datasett, litt som et bitmap-bilde der hver pixel er gjengitt som et eget uavhengig datapunkt med den fulle bitoppløsningen for å generere rett farge og lys.

Feilene i dette er mange. For det første refererer han til tre kilder som hver for seg sier noe annet enn han gir dem kreditt for. Eksempelvis dette med transienter er multifrekvens events som skjer med en viss samtidighet. Vi kan se av artikkelen forøvrig at han beskriver det som nærmest noe av en sensasjon at vi kan høre forskjell på en pianotone avspilt forover og den samme tonen avspilt bakover, selv om frekvensinnholdet er ganske likt. Men faktum er at vi klarer oss med en håndfull frekvenser for å sortere det som en transient. Jeg kommer tilbake til dette litt senere, men essensen her er at han behandler en transient bestående av 100 frekvenser som 100 individuelle hendelser der hver enkelt av dem tolkes i tidsdomenet av hjernen og behandles individuelt. Han legger også til grunn en dynamisk oppløsning på 100dB som nærmest er et statisk dynamikkområde. Det han i essens sier er at om vi har en transient på 120dB og en på 21dB i samme frekvensområde som skjer samtidig, så klarer vi å høre om den på 21dB flyttes i tid eller økes til 22dB. Referansene hans peker i langt større grad på at den maskeres ut ekstremt effektivt og er veldig langt utenfor hva vi kan høre.

Vi har også en forholdsvis godt kjent frekvensoppløsning på omkring 1000 punkter. Han går her ut i fra at hver fungerende nervetråd (ca 31000 - 32000 mener jeg skal være rett tall for et ungt menneske) behandles som et individuelt datapunkt, og at vi har den samme frekvensoppløsningen i hele området. Dette er fullstendig feil. Vi har en forholdsvis fungerende frekvensoppløsning på ca 1000 toner fordelt på rett under 10 oktaver. Det er 12 halve tonetrinn pr oktav, noe som gir oss teoretisk nesten 8,5 tonetrinn pr halvtone. Imidlertid er vår evne til å skille toner fra hverandre svært avhengig av frekvens og lydstyrke. Ved 80dB skiller vi toner ved 500-2kHz svært effektivt, mens ved 40dB og under 100Hz eller over 10kHz sliter vi kraftig. Her kan selv heltoner by på utfordringer.

Det er med andre ord noen helt, ja astronomiske overdrivelser her. (putter inn referanse 29 slik at alle vet hva astronomisk betyr). Det interessante her er at han forutsetter at et datasett på 16 bit (~10^5) ikke bare lagres 100% komplett i hjernen, men med 10^35 datapunkter pr bit i det opprinnelige signalet. En påstand så urimelig at jeg knapt vet hvor jeg skal begynne.

The vast detailed information of the NEP creates a problem for blind listening tests. The traditional quick AB tests are based on the rationale that having a long gap between A and B may cause the subject to forget the first sound. This is a mistake because the subject will then be relying on short-term memory, which lasts up to 15-30 seconds and can hold only about four items. This can work well when a single parameter is changed in a simple sound (e.g., differentiating the just noticeable difference (JND) in frequency for a pure tone). However, differences in timbre due to audio distortions involve myriad subtle changes in the neural excitation pattern. These are beyond the capacity of short-term memory. To absorb this detailed information requires listening to complex music for long periods with a “palate cleansing” break of a minute or longer between A and B. This resets short-term memory and invokes the durable and infinitely more detailed long-term memory. This extended-multiple-pass (EMP) listening approach led to the historic proof that cable pathways between audio components make an audible difference [3].

Her går han direkte inn i en antakelse om at for å skille A og B fra hverandre er vi nødt til å huske 100% av all informasjonen som utgjør alle teoretisk mulige punkter av ørets oppløsning. Det er litt som å stille noen foran dette 122 megapixel bildet fra JWT (

https://esawebb.org/images/weic2212a/), endre 10 tilfeldig valgte av pixlenes fargetone med 1%, og be noen om å identifisere disse pixlene etter en 10 minutters pause. Vel, bare at Kutcher sin påstand er dette problemet, ganget med, ja, et astrononisk tall.

Dersom vi skulle sjekke om vi kunne se forskjell på disse pixlene kunne vi i stedet bruke metoder vi kjenner fra rask AB-testing. Vi kunne velge ut akkurat disse pixlene (bruke software som kan identifisere de faktiske forskjellene) og plassere dem ved siden av hverandre i før og etter endring-versjon, bare ett og ett pixel blåst opp til full størrelse. Vi kunne evt klikke frem og tilbake mellom A og B for å se om vi registrerer en endring i fargetonen. Men om vi legger inn en pause på et minutt, eller kanskje til og med så lite som ett sekund, så er sjansen overhengende for at forskjellen er som blåst bort.

Innenfor blindtesting er det ingen ting vi heller vil enn å komme frem til at vi kan høre en forskjell. Det er mulig å manipulere en blindtest på alle mulige måter for å få til dette. Vi kan for eksempel måle forskjellene så vi vet mer om hva som kan og bør eksponeres. Kommer vil til at det er en forskjell ved 10kHz hjelper det lite å forsøke å eksponere dette med kontrabass spilt inn på lang avstand. Dersom forskjellen også har sammenheng med tidsdomenet kan man velge musikk som eksponerer dette spesielt effektivt i det aktuelle området. Man kan få inn trente lyttere som hjelper til med å fokusere på de riktige detaljene slik at man får "knagger" å henge ting på og slipper å konsentrere seg om ting som bidrar til å skape forvirring. Man kan trene så lenge man vil på å finne disse forskjellene, og man kan velge hvor korte eller lange pass man ønsker. Ønsker man pauser er det selvsagt helt, det er ingen ting i formatet blindtest som sier at vi ikke kan kjøre pass som varer en uke, eller en måned, og om man ønsker, en ukes pause mellom.

Men formålet er fortsatt å se om man klarer å identifisere A fra B uten å vite hvilken som spiller. Så selv om Kunchur hevder at vi må bruke lange pass konkluderer han altså basert på det med at vi må vite hva som spiller for å kunne høre forskjell. Det er imidlertid absolutt ingen ting i det som Kunchur hevder som underbygger en slik påstand, og det er definitivt ikke noe i kildene hans som sier dette.

For den interesserte, ta en liten kikk på kilden som brukes for å underbygge påstanden om at vi må kjøre lange pass. Den der man har forsket på Guinea-grisers hørsel, og kommet til at deres tidsoppløsning går ned til omtrent null ved 3,5kHz. Jeg har ikke lest hele artikkelen, men ut fra abstract ser den ikke ut til å gå særlig langt i å underbygge Kunchers påstander. Faktisk ser den ikke å handle om mennesker, akustisk minne eller noe annet relevant. Man har målt på hørselsnervene og sett at nervepulsene ikke er presist nok timet ut av øre til at hjernen lenger har noen faseinformasjon å behandle høyt i frekvens.

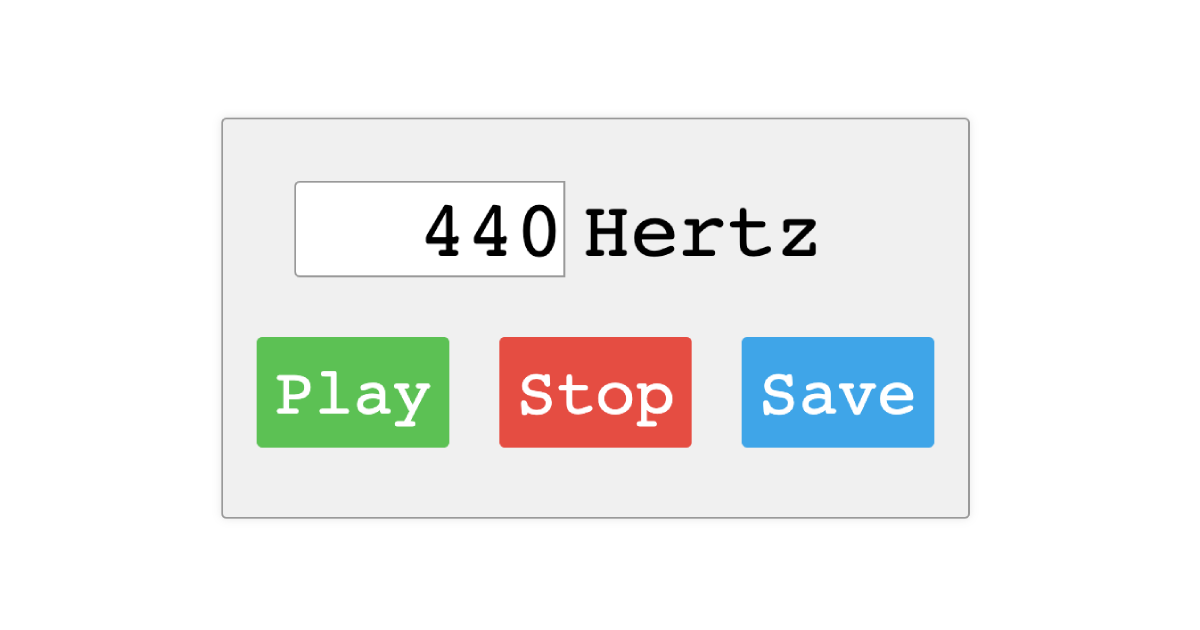

Om Kuncher kan motbevises? Vel, først bør han bevise at han faktisk har rett. Hans påstand om at vi ikke kan teste blindt kan lett tilbakevises av at alle hans testforutsetninger kan gjøres blindt. Men vi kan gjøre dette ganske mye lettere. Gå til denne online tonegeneratoren og test følgende:

Simply enter your desired frequency and press play to hear your tone. It's free, simple and easy to use.

onlinetonegenerator.com

1: Hvor lett er det å identifisere hvor en 1000Hz sinus vs en 10 000Hz sinus kommer fra?

2: Hvor lett er det å identifisere hvor en 500Hz sinus vs en 500Hz firkant kommer fra?

3: Hvor stor forskjell hører du på en 4000Hz sinus vs en 4000Hz firkant?

Her er hva vitenskapen sier, mens som Kuncher er uenig i:

1: Det skal være lettere å plassere 1kHz, mens 10kHz skal til en viss grad la seg plassere.

2: Det skal være lettere å plassere 500Hz firkant enn 500Hz sinus på grunn av den transiente naturen til firkantbølger.

3: Det skal være liten eller ingen forskjell på 4000Hz sinus og 4000Hz firkant. Dette skyldes at bidraget fra den 3. harmoniske ved 12kHz er såpass lavt i nivå at det maskeres av grunntonen.

PS: Det kan være at enkelte enheter gjengir lydene med uønskede artefakter, disse er selvsagt ikke en del av saken.