Ny rapport: Fem av ti unge tror at KI kan gjøre dem late

Selv om bruken av kunstig intelligens fortsatt skyter fart blant de unge, er det langt fra alle som kaster seg på KI-bølgen. – Det er spennende, men også skummelt, sier Samuel Mayani (18).

Ser ut som det kan gå enda fortere.Tipper at bobla sprekker om et par-tre år. ”Almost no economic impact.“

What happened to the artificial-intelligence revolution?

So far the technology has had almost no economic impactwww.economist.com

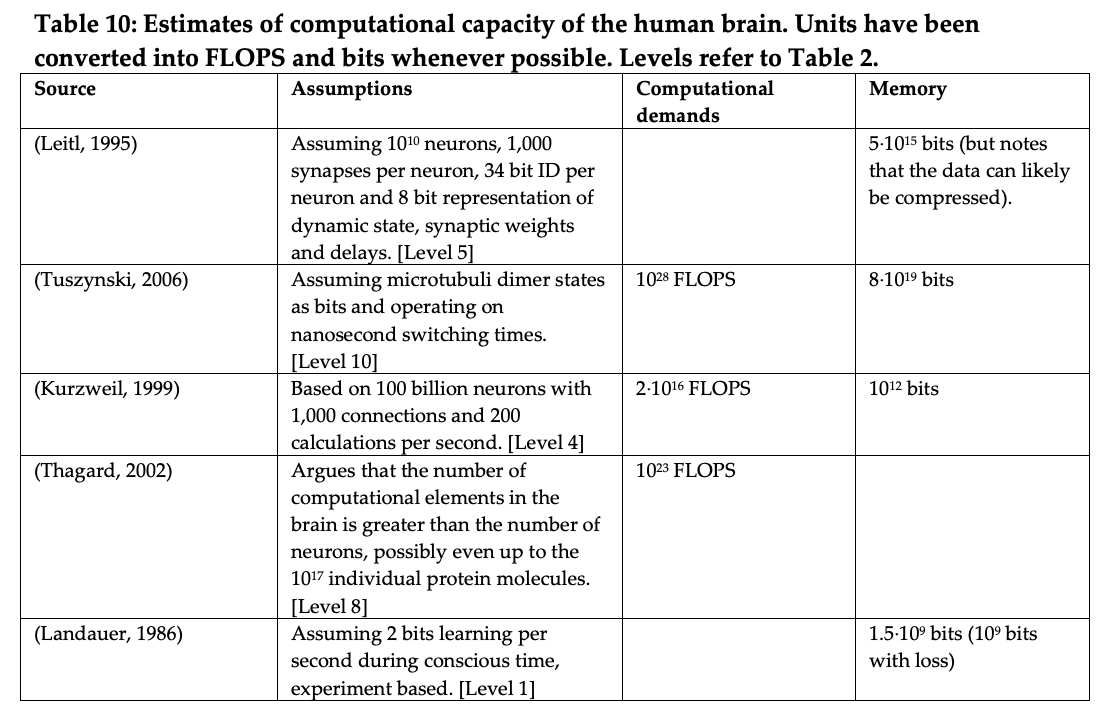

Jeg leste en forskningskommentar i Morgenbladet om KI. Den pekte på at grunnen til at AGI fortsatt er langt unna, er at datamaskinen aldri har vært baby og dermed ikke trengt å forholde seg til en fysisk og sosial verden. Løsningen ville være å lage en ny modell som simulerte at datamaskinen hadde vært baby.Jeg har liten tiltro til at vi har noen fullstendig forståelse av hvordan hjernen fungerer, og derfor har jeg heller aldri hatt noen tro på AGI. Vi kan lage bedre modeller av en hjernes oppførsel i dag enn for femti år siden, men de er nok fortsatt veldig langt fra fullendt.

Sant, men det neurale nettverket i dagens AI’er er en forenklet simulering av biologiske neuroner. Det er vektinger som styrer styrken av koblinger fra input til output. Datamaskinen lagrer og husker helt eksakt at en bestemt faktor f eks har verdien 0,8765, men det neurale nettverket den inngår i husker ikke eksakt. Det assosierer, at noe vanligvis hører sammen med noe annet, beregner sannsynligheter og velger utfall ut fra genererte pseudotilfeldige tall. Om du kjører samme forespørsel to ganger med ulike «frø» for slumptallsgeneratoren vil du få ulikt utfall selv om alt annet er likt.Slike sammenlikninger fremstår for meg som litt meningsløse. En menneskehjerne lagrer ikke informasjon på samme måte som en datamaskin. Datamaskinen kan gjengi lagret informasjon eksakt, men når vi husker noe så er ikke minnet noe som en gang likner på informasjonsinnholdet som det vi husker opprinnelig bestod av. Og om vi husker noe to ganger, er informasjonsinnholdet også helt forskjellig de to gangene. Til og med memorisering (feks å pugge sifrene i pi) skjer gjennom assosiasjon, ikke gjennom lagring av tallene per se.

Jeg har liten tiltro til at vi har noen fullstendig forståelse av hvordan hjernen fungerer, og derfor har jeg heller aldri hatt noen tro på AGI. Vi kan lage bedre modeller av en hjernes oppførsel i dag enn for femti år siden, men de er nok fortsatt veldig langt fra fullendt.

Det stemmer nok, men nevronene er strengt tatt relativt enkle å forstå. Det er hvordan det hele henger sammen vi ikke forstår. Det fins ingen helhetlig teori om hvordan hjernen fungerer. Det er derfor det ikke er uproblematisk å bruke datamaskiners lagringskapasitet som metafor for hvordan hjernen håndterer informasjon.Sant, men det neurale nettverket i dagens AI’er er en forenklet simulering av biologiske neuroner.

spectrum.ieee.org

spectrum.ieee.org

A cinematic still image showing a group of viking warriors on foot. One warrior is carrying a triangular, tasseled banner showing a black raven with outstretched wings on a white field. The other vikings wear iron helmets and chain-mail armor. The vikings are grimy and blood-stained, on their way from one violent battle to another. They carry swords, battle-axes, shields, and torches. Darkness is falling. A burning castle can be seen in the background. The overall impression is one of quiet menace and impending violence.

Det gjenstår å se om den kan brukes til noe som helst, bortsett fra å kjøre en oppkonstruert algoritme nettopp for å simulere en kvanteprosessor.Bruk Willow.